APU | Stable-Diffusion 使用记录

Stable-Diffusion 是这几年里比较火的 AiGC 框架之一,目前可以支持以文生图、以图生图、视频生成。

对于没有独立显卡的电脑来说,这几乎无法本地部署使用,但是最近已经有了些新进展。

针对使用 Ryzen GPU 以及 APU处理器,AMD 和 Stable-Diffusion 官方合作推出了相关优化的模型和前端软件(amuse)。

新闻:https://stability.ai/news/stable-diffusion-now-optimized-for-amd-radeon-gpus

目前已经支持 SDXL / SD3 / SD3.5 包括 Large 和 Large Turbo 版本。

我的硬件:无界15xPro Ai9H365(880m核显) 32G x 2 双通道 DDR5 5600MHZ 内存, 截止目前,下面是我尝试和踩过的一些坑(可能还会更新)。

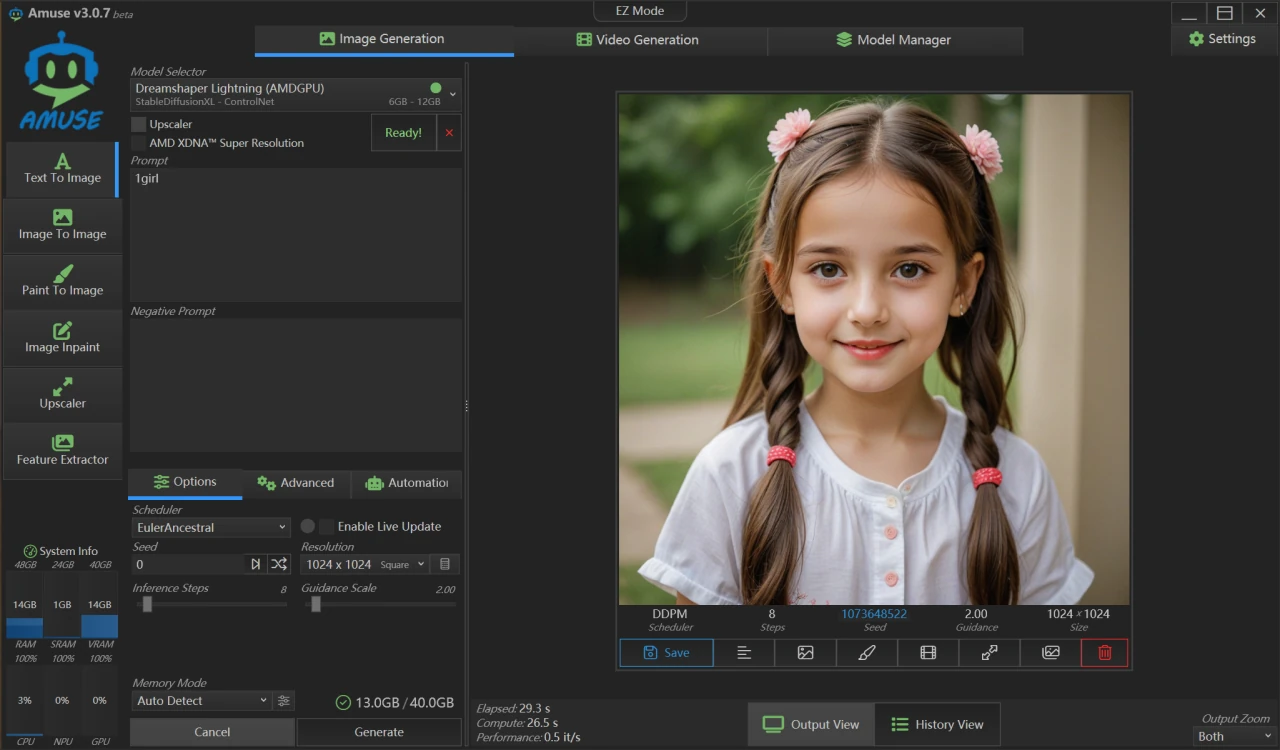

1. amuse-ai

软件官网:https://www.amuse-ai.com/

这是 AMD 官方指定的尝鲜平台,可以让新手很快上手 SD,不需要繁杂的命令构建过程。

优势:基于官方的优化算法,我测试他们软件提供的 DreamShaper XL 模型(基于SDXL Lightning) 以 512x512 的图片下,最快可达到 2 ~ 3it/s 的速度,而 1024x1024 图片可 0.5 ~ 0.8it/s 水平,这相比纯 CPU 算提升非常大。

缺点:(一) 只支持 Windows , (二) 不支持很多 Lora 微调模型,(三) 这个软件截止目前是闭源的,并且会有屏蔽限制(不允许出现成人内容等)。

博主去搜了一下找到了暂时的解决方案,如果是 3.0 的版本,需要去 C:\Users\你的用户名\AppData\Local\Amuse 下的 appsettings.json 修改 IsModelEvaluationModeEnabled 设置为 false,这样再重新打开软件可去除屏蔽。不过这只是缓兵之计,以后还是要看 Amuse 的态度。

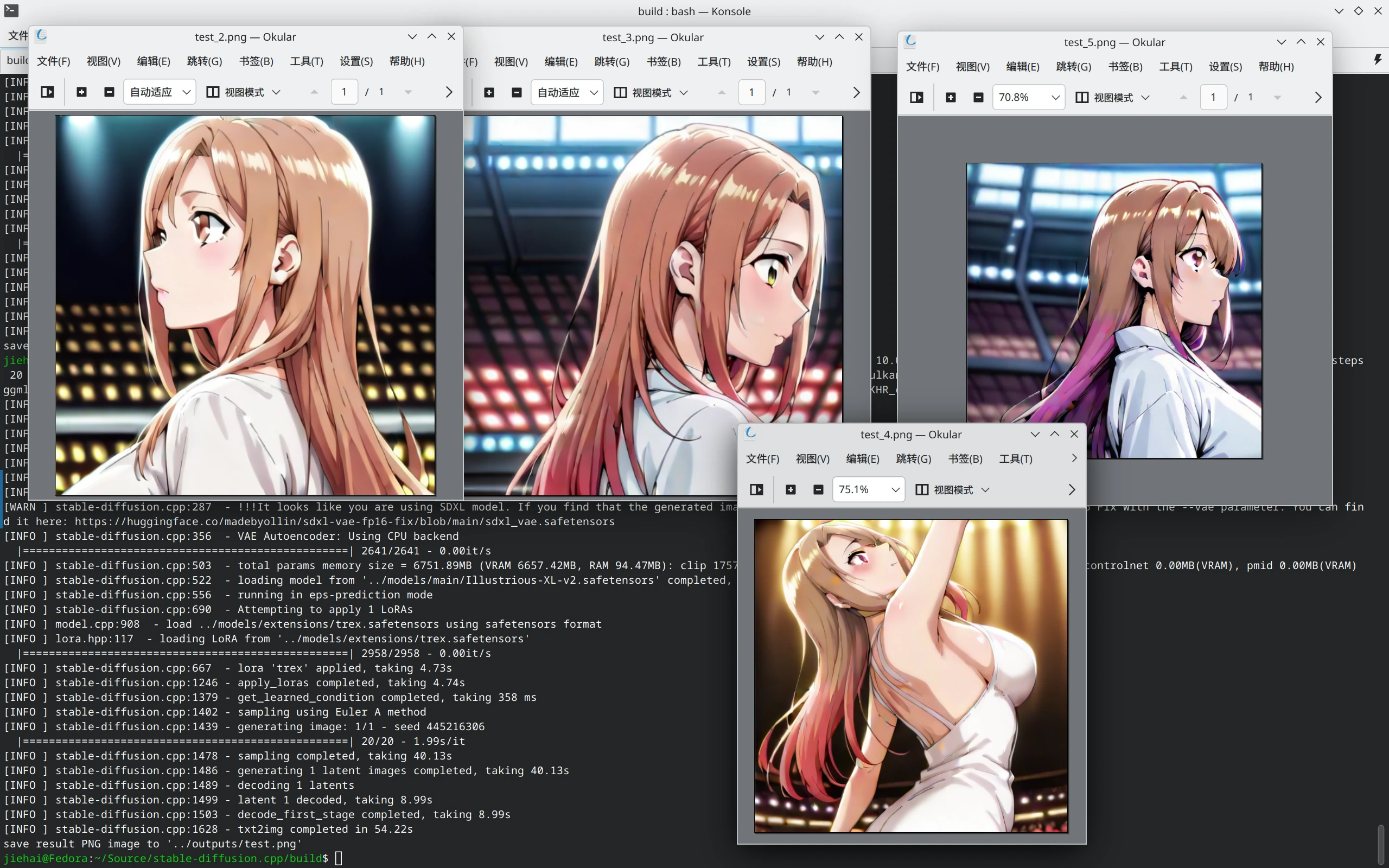

2. stable-diffusion.cpp

项目地址:https://github.com/leejet/stable-diffusion.cpp

这是一个支持 Vulkan 推理的 sd 项目,对于一般人来说可能需要点动手能力的方案,因为没有图形界面只有命令行工具。

优势:(一) 几乎支持所有显卡包括核显,可以 CUDA、ROCm、Metal、Vulkan 和 SYCL 作为后端来加速推理。(二) 开源并且支持 win / linux / mac 构建,(三) 没有屏蔽限制随意输出内容,可以使用第三方 Lora 微调模型。

这里推荐一个网站:https://civitai.com/models 可以从这找到各种 Lora

缺点:(一) 暂时不支持视频生成 (二) 目前 Vulkan 推理相比 Amuse 来说加速效果一般,经过测试,Illustrious-XL_V2(基于 SDXL ) 512x512 的图走 8 个采样步数需要 20多秒,差不多在 0.2 ~ 0.5it/s 水平。而 amuse 几乎只需要几秒种。 1024x1024 更是只有 0.1 ~ 0.2it/s,出一张图要几分钟,如果你比较耐心的话还是可以凑合用一下